AI 시대의 도래 (Codex 모델들)

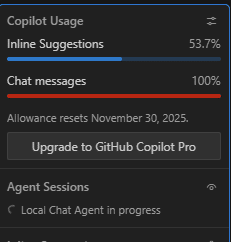

이제는 AI 없이 코딩하는 것은 매우 비효율적입니다. 여러 조사 결과처럼 AI 도구들은 개발자의 생산성을 향상시켜 줍니다. 그러나 저처럼 무료 사용자는 Cloud quota를 금방 소진해서, 추가적인 방법이 필요 합니다. 또한 보안이 중요한 프로젝트에서는 코드를 외부로 전송할 수 없어 로컬 LLM이 필수입니다.

GPU 없이, AI 사용하기

대형 기업이라면, 자체적인 GPU 센터 및 자체 모델 또는 OSS 모델을 이용해서 구축할 수 있습니다. 하지만 개인 개발자에게는 GPU 비용이 부담스럽습니다.

Qwen-coder 모델을 사용해 보았는데, 최소 30B 모델은 되어야 쓸만했습니다. 30B 모델을 CPU만으로 실행하면 추론 속도가 너무 느려서 실제 코딩에 사용하기 어렵습니다.

OLLAMA – Cloud 모델 사용하기

OLLAMA란?

Ollama is the easiest way to get up and running with large language models such as gpt-oss, Gemma 3, DeepSeek-R1, Qwen3 and more.

OLLAMA는 여러 LLM을 사용할 수 있게 해줍니다. 특히 최근 버전부터 Cloud 모델을 지원하고 있습니다.

Cloud 모델은 로컬에는 얇은 레이어만 설치하고, 실제 추론은 Ollama 서버에서 동작합니다. 이 방식을 사용하면 480B 같은 초대형 모델도 로컬에서 사용 가능합니다.

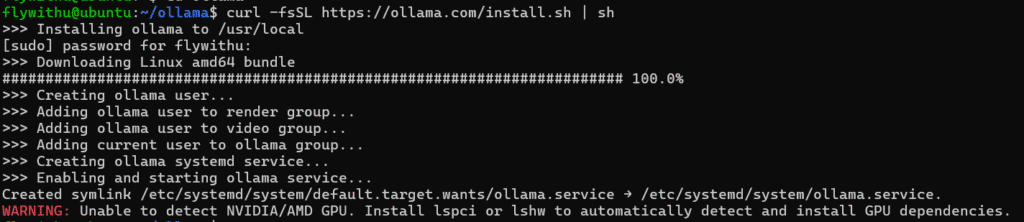

OLLAMA 설치 하기 – Linux CLI 기준

# OLLAMA 설치

curl -fsSL https://ollama.com/install.sh | sh

# Cloud 모델 다운로드

ollama pull qwen3-coder:480b-cloud

# Ollama 로그인

ollama signin

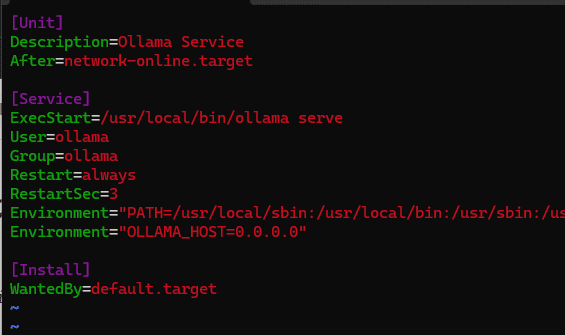

# 외부 접속 설정

sudo nano /etc/systemd/system/ollama.service

Environment="OLLAMA_HOST=0.0.0.0"

sudo systemctl daemon-reload

sudo systemctl restart ollama

윈도우 사용자의 경우:

https://ollama.com/download/windows 에서 Windows용 설치 파일을 다운로드하여 설치하시면 됩니다.

참고:

로컬 설치 없이 Ollama API로 직접 접근하는 방법도 고려했으나, Python에서는 가능했지만 VS Code Copilot 설정에서는 해당 옵션을 찾지 못했습니다.

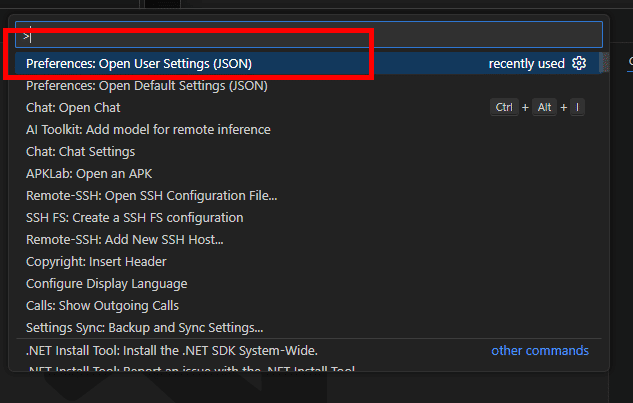

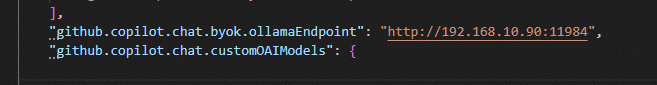

VS Code설정 하기

Ctrl + Shift + P를 눌러 User Settings를 엽니다.

"github.copilot.chat.byok.ollamaEndpoint": "http://192.168.10.90:11434"

NAS나 Docker 환경에서도 동일하게 설정 가능합니다.

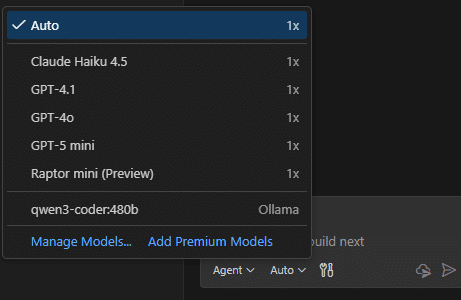

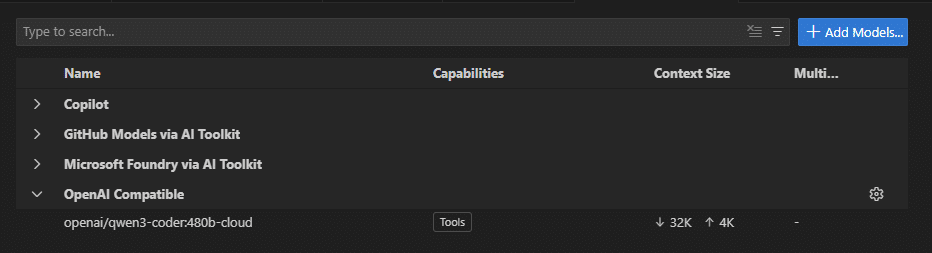

이제 VS Code에서 copilot 에서 보면 qwen3-coder 480b 가 보입니다.

이제 Qwen3-coder를 사용할수 있습니다.

테스트 영상은 아래와 같습니다.

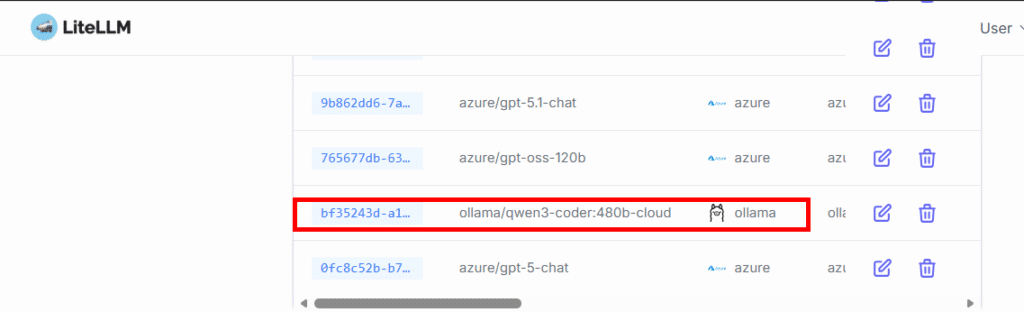

LiteLLM 으로 확장 하기

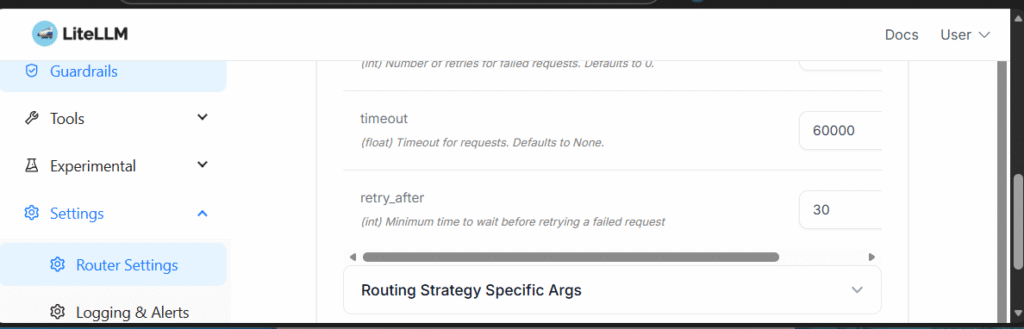

저는 Ollama를 LiteLLM Proxy를 경유해서 사용합니다. LiteLLM은 여러 LLM 제공자를 통합 관리할 수 있는 프록시 서버입니다.

이렇게 사용하면 여러 장점이 있습니다. AI를 자주 사용할 때 발생하는 429 에러(Too Many Requests)를 줄일 수 있습니다. routing 옵션을 추가하면 재시도를 자동으로 처리해주기 때문입니다. 또한 fallback 모델들을 추가하면 한 모델이 실패해도 다른 모델이 대체하여 작업을 완료할 수 있습니다.

LiteLLM을 연결하려면 VS Code-insider 버전이 필요합니다. 아래 이미지에서 볼 수 있듯이 왼쪽이 정식 버전, 오른쪽이 Insider 버전 아이콘입니다. . [https://code.visualstudio.com/insiders]

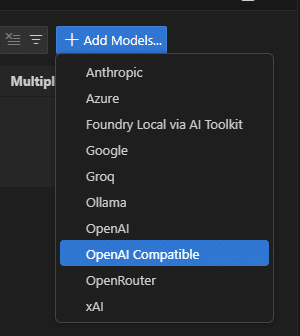

OpenAI compatible 을 지원하는 방법이 찾아보면 여러개 있는데 저한테 동작한것은 insider 버젼 설치 였습니다. model 추가도 아래와 같이UI가 잘 되어 있습니다.

이번에 Qwen 모델의 큰 도움을 받았습니다.

다음 POST 에서 올리겠습니다.